隨著人工智能技術(shù)的快速發(fā)展,越來(lái)越多的企業(yè)和開(kāi)發(fā)者開(kāi)始涉足AI項(xiàng)目的開(kāi)發(fā)與部署。一個(gè)合適的服務(wù)器配置對(duì)于A(yíng)I項(xiàng)目的成功至關(guān)重要。本文將詳細(xì)介紹人工智能開(kāi)發(fā)與部署所需的服務(wù)器配置,以及相關(guān)的網(wǎng)絡(luò)技術(shù)開(kāi)發(fā)要點(diǎn)。

一、硬件配置要求

- 中央處理器(CPU)

- 多核心高性能CPU:AI訓(xùn)練和推理任務(wù)通常需要大量的并行計(jì)算,建議選擇至少16核心以上的CPU,如Intel Xeon或AMD EPYC系列。

- 高主頻:高主頻的CPU能夠提升單線(xiàn)程任務(wù)的執(zhí)行效率,對(duì)于某些AI模型的推理階段尤為重要。

- 圖形處理器(GPU)

- 高性能GPU:深度學(xué)習(xí)模型的訓(xùn)練對(duì)GPU性能要求極高。NVIDIA的Tesla、A100或RTX系列是常見(jiàn)選擇,顯存建議至少16GB,對(duì)于大規(guī)模模型可能需要32GB或更高。

- 多GPU配置:對(duì)于復(fù)雜的AI任務(wù),多GPU并行計(jì)算可以顯著提升效率。服務(wù)器應(yīng)支持多GPU插槽和高速互聯(lián)技術(shù)(如NVLink)。

- 內(nèi)存(RAM)

- 大容量?jī)?nèi)存:AI模型訓(xùn)練和數(shù)據(jù)處理需要大量?jī)?nèi)存,建議配置至少64GB,對(duì)于大規(guī)模項(xiàng)目可能需要128GB或更高。

- 高帶寬內(nèi)存:選擇DDR4或DDR5內(nèi)存,以確保數(shù)據(jù)讀寫(xiě)速度能夠滿(mǎn)足AI計(jì)算的需求。

- 存儲(chǔ)系統(tǒng)

- 高速固態(tài)硬盤(pán)(SSD):AI項(xiàng)目涉及大量的數(shù)據(jù)讀寫(xiě),建議使用NVMe SSD作為主存儲(chǔ),以提升數(shù)據(jù)加載速度。

- 大容量硬盤(pán):對(duì)于數(shù)據(jù)存儲(chǔ)和備份,可以搭配大容量的HDD或SATA SSD。

- RAID配置:通過(guò)RAID技術(shù)提升數(shù)據(jù)冗余和讀寫(xiě)性能。

- 網(wǎng)絡(luò)接口

- 高速網(wǎng)卡:建議配置10GbE或更高速率的網(wǎng)卡,以確保數(shù)據(jù)傳輸效率,特別是在分布式訓(xùn)練場(chǎng)景下。

- 低延遲網(wǎng)絡(luò):對(duì)于實(shí)時(shí)AI應(yīng)用,低延遲網(wǎng)絡(luò)至關(guān)重要。

二、軟件環(huán)境配置

- 操作系統(tǒng)

- Linux系統(tǒng):大多數(shù)AI開(kāi)發(fā)環(huán)境基于Linux,如Ubuntu或CentOS,因其穩(wěn)定性和對(duì)高性能計(jì)算的良好支持。

- 開(kāi)發(fā)框架與工具

- 深度學(xué)習(xí)框架:如TensorFlow、PyTorch等,需根據(jù)項(xiàng)目需求安裝相應(yīng)版本。

- 編程語(yǔ)言:Python是AI開(kāi)發(fā)的主流語(yǔ)言,需安裝相關(guān)庫(kù)(如NumPy、Pandas)。

- 容器技術(shù):使用Docker或Kubernetes可以簡(jiǎn)化環(huán)境部署和管理。

- 驅(qū)動(dòng)與庫(kù)

- GPU驅(qū)動(dòng):安裝最新版本的NVIDIA驅(qū)動(dòng)和CUDA工具包,以充分發(fā)揮GPU性能。

- 加速庫(kù):如cuDNN、NCCL等,用于優(yōu)化深度學(xué)習(xí)計(jì)算。

三、網(wǎng)絡(luò)技術(shù)開(kāi)發(fā)要點(diǎn)

- 分布式訓(xùn)練

- 多節(jié)點(diǎn)協(xié)作:通過(guò)高速網(wǎng)絡(luò)連接多臺(tái)服務(wù)器,實(shí)現(xiàn)模型的分布式訓(xùn)練,提升訓(xùn)練效率。

- 通信優(yōu)化:使用MPI或NCCL等通信庫(kù),減少節(jié)點(diǎn)間的數(shù)據(jù)傳輸延遲。

- 云原生與微服務(wù)

- 容器化部署:利用Docker和Kubernetes實(shí)現(xiàn)AI應(yīng)用的快速部署和擴(kuò)展。

- API開(kāi)發(fā):為AI模型提供RESTful或gRPC接口,便于與其他系統(tǒng)集成。

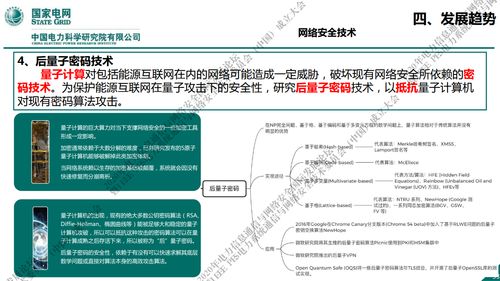

- 網(wǎng)絡(luò)安全與數(shù)據(jù)隱私

- 加密通信:使用TLS/SSL協(xié)議保護(hù)數(shù)據(jù)傳輸安全。

- 訪(fǎng)問(wèn)控制:通過(guò)防火墻和身份驗(yàn)證機(jī)制,限制未授權(quán)訪(fǎng)問(wèn)。

四、實(shí)際部署建議

- 根據(jù)項(xiàng)目規(guī)模選擇配置:小規(guī)模項(xiàng)目可選擇單臺(tái)高性能服務(wù)器,大規(guī)模項(xiàng)目需考慮集群部署。

- 彈性擴(kuò)展:利用云計(jì)算平臺(tái)(如AWS、Azure)的彈性資源,根據(jù)需要?jiǎng)討B(tài)調(diào)整服務(wù)器配置。

- 監(jiān)控與優(yōu)化:使用監(jiān)控工具(如Prometheus、Grafana)實(shí)時(shí)跟蹤服務(wù)器性能,及時(shí)優(yōu)化資源配置。

人工智能開(kāi)發(fā)與部署的服務(wù)器配置需要綜合考慮硬件性能、軟件環(huán)境和網(wǎng)絡(luò)技術(shù)。只有合理配置,才能確保AI項(xiàng)目的高效運(yùn)行和成功落地。